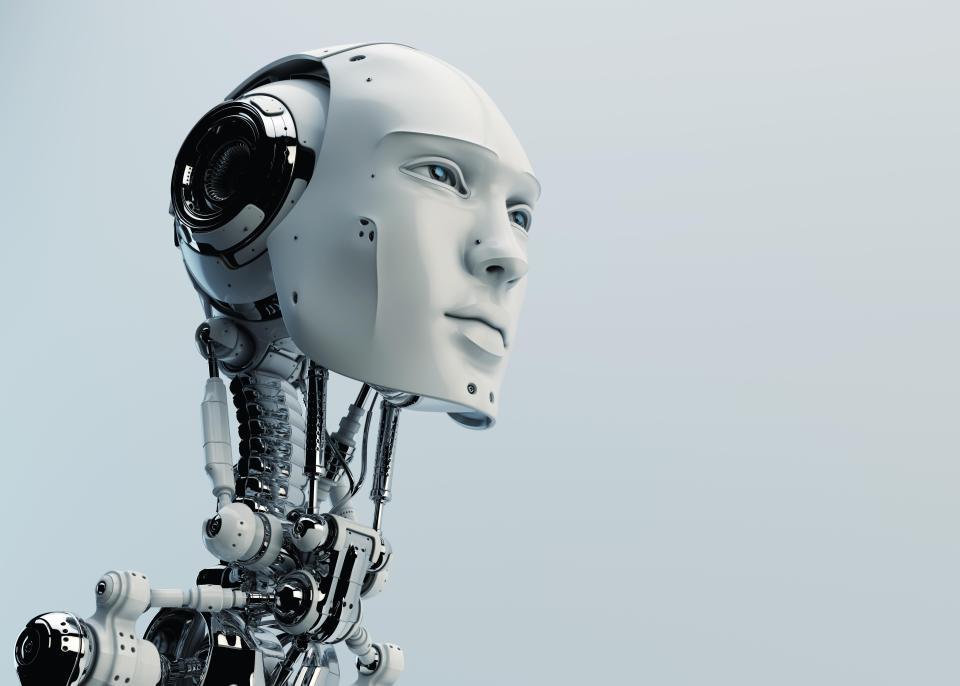

机器人三原则分别是:

第一条:机器人兆派凯不得伤害人类,或看到人类受到伤害而袖手旁观.

第二条:机器人必须服从人类的命令,除非这条命令与第一条相矛盾。

第三条:机器人必须保护自己,除非这种保护与以上两条相矛盾。

机器人三原则是1940年由科幻作家阿西莫夫所提出的为保护人类的对机器人做出的规定。

起源:科学技术的进步很可能引发一些人类不希望出现的问题。为了保护人类,早在1940年科幻作家阿西莫夫就提出了“机器人三原则”,阿西莫夫也因此获得“机器人学之父”的桂冠!

机器人三原则出现的原因:

人类制造的智能机器人威胁到人类自身的生存,这被称为“族唤技术奇点”问题。技术奇点是指拥有人类智能的机器人不断改进自己,并且制造或繁殖越来越聪明、越来越强大的机器人,最终达到人类不可预测、无法控制的地步。

如果制造智能机器人的技术越过这一奇点,局面将无法收拾,会伤害人类甚至使人类面临灭亡危险。但人类可以防患于未然,防止机器人制造技术达到或超越这一技术奇点完全是有可能的,关键是我们有无能力使设计、制羡此造机器人的科学家和制造商遵守人工智能发展的规则。

参考资料来源:百度百科-机器人三原则